راهنمای نهایی بهینه سازی وردپرس Robots.txt

راهنمای نهایی بهینه سازی وردپرس Robots.txt

وقتی یک وبلاگ یا وب سایت در وردپرس ایجاد می کنید، یک فایل robots.txt به طور خودکار برای هر یک از صفحات فرود و پست های شما ایجاد می شود. این یکی از جنبه های مهم سئوی وب سایت شما است، زیرا موتورهای جستجو هنگام خزیدن در محتوای سایت شما از آن استفاده می کنند.

اگر میخواهید سئوی وبسایت خود را به سطح بالاتری ببرید، بهینهسازی فایل robots.txt در سایت وردپرس شما مهم است، اما، متأسفانه، به سادگی افزودن کلمات کلیدی به محتوای خود نیست. به همین دلیل است که ما این راهنما را برای WordPress robots.txt آماده کرده ایم تا بتوانید آن را کامل کنید و رتبه جستجوی خود را بهبود بخشید.

فایل Robots.txt چیست؟

وقتی وبسایتها را در صفحات نتایج موتورهای جستجو (SERP) قرار میدهید، موتورهای جستجو مانند Google صفحات وبسایت را «خزیدن» کرده و محتوای آنها را تجزیه و تحلیل میکنند. فایل robots.txt هر وبسایتی به «رباتها» خزنده میگوید که کدام صفحات را بخزد و کدام صفحات را خزید – اساساً شکلی از اتوماسیون فرآیند رباتیک (RPA).

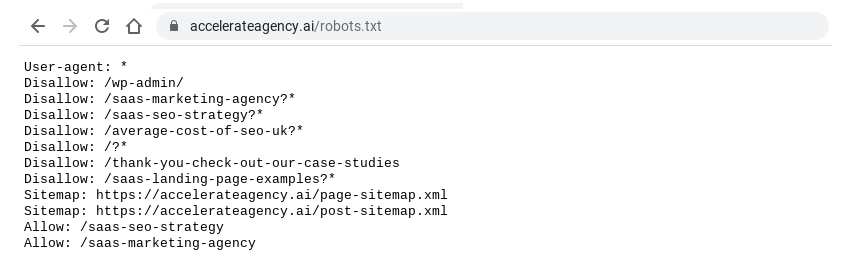

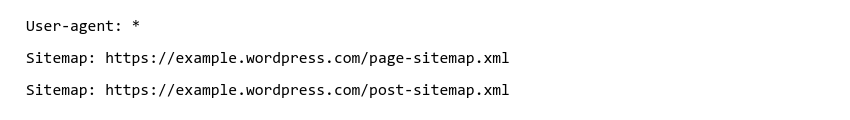

می توانید فایل robots.txt هر وب سایتی را با تایپ /robots.txt بعد از نام دامنه مشاهده کنید. چیزی شبیه این خواهد بود:

بیایید هر یک از عناصر موجود در تصویر بالا را تجزیه کنیم.

عامل کاربر

user-agent در فایل robots.txt موتور جستجویی است که فایل robots.txt باید توسط آن خوانده شود. در مثال بالا، user-agent با یک ستاره مشخص شده است، به این معنی که برای همه موتورهای جستجو اعمال می شود.

بیشتر وب سایت ها خوشحال می شوند که همه موتورهای جستجو در سایت خود بخزند، اما گاهی اوقات ممکن است بخواهید همه موتورهای جستجو به جز Google را از خزیدن در سایت خود مسدود کنید یا دستورالعمل های خاصی برای نحوه خزیدن وب سایت شما توسط موتورهای جستجو مانند Google News یا Google Images ارائه دهید.

اگر چنین است، باید شناسه عامل کاربر موتورهای جستجویی را که میخواهید آموزش دهید، پیدا کنید. این به اندازه کافی ساده است که بتوان آن را به صورت آنلاین پیدا کرد، اما در اینجا برخی از موارد اصلی وجود دارد:

- Google: Googlebot

- اخبار Google: Googlebot-News

- تصاویر Google: Googlebot-Image

- Google Video: Googlebot-Video

- Bing: Bingbot

- Yahoo: Slurp Bot

مجاز و غیر مجاز

در فایلهای robots.txt، مجاز و غیر مجاز به رباتها میگوید که کدام صفحات و محتوا را میتوانند و نمیتوانند بخزند. اگر همانطور که در بالا ذکر شد، می خواهید تمام موتورهای جستجو به جز گوگل را از خزیدن وب سایت خود مسدود کنید، می توانید از robots.txt زیر استفاده کنید:

اسلش (/) بعد از «عدم اجازه» و «مجاز» به ربات میگوید که اجازه دارد یا اجازه خزیدن در تمام صفحات را ندارد. همچنین می توانید صفحات خاصی را در بین اسلش ها قرار دهید تا به ربات اجازه خزیدن در آنها داده شود.

نقشه سایت

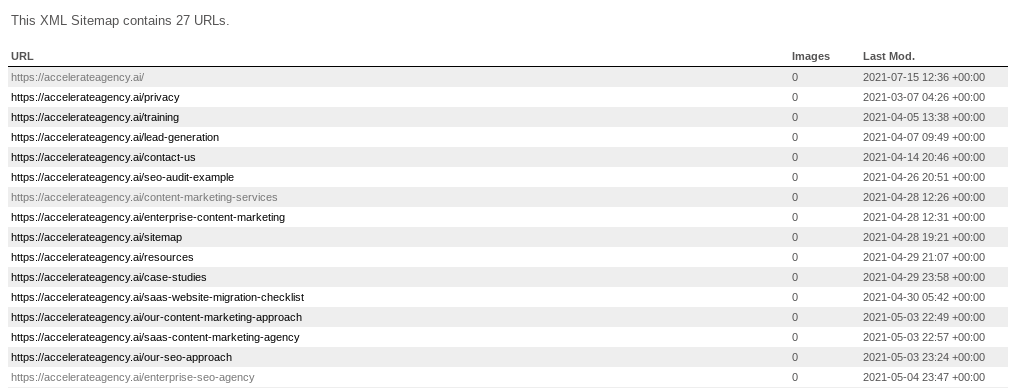

“نقشه سایت” در فایل robots.txt یک فایل XML است که حاوی لیست و جزئیات تمام صفحات وب سایت شما است. به نظر می رسد این است:

نقشه سایت شامل تمام صفحات وب است که می خواهید ربات آنها را کشف کند. اگر صفحات وب دارید که میخواهید در نتایج جستجو نمایش داده شوند، اما صفحات فرود معمولی نیستند – مانند پستهای وبلاگ، نقشه سایت بسیار مفید است.

نقشههای سایت به ویژه برای کاربران وردپرس مهم هستند که امیدوارند با پستهای وبلاگ و صفحات دستهبندی، وبسایت خود را دوباره تقویت کنید. اگر نقشه سایت robots.txt خود را نداشته باشند، ممکن است بسیاری از اینها در SERP ظاهر نشوند.

اینها جنبه های اصلی فایل robots.txt هستند. البته باید توجه داشت که فایل robots.txt شما یک راه مطمئن برای جلوگیری از خزیدن ربات های موتور جستجو در صفحات خاص نیست. برای مثال، اگر سایت دیگری از انکر متون برای پیوند دادن به صفحهای استفاده میکند که شما آن را «غیر مجاز» کردهاید. در فایل robots.txt شما، رباتهای موتور جستجو همچنان میتوانند آن صفحه را بخزند.

آیا به فایل Robots.txt در وردپرس نیاز دارید؟

اگر وب سایت یا وبلاگی دارید که توسط وردپرس پشتیبانی می شود، از قبل یک فایل robots.txt که به طور خودکار تولید می شود خواهید داشت. اگر میخواهید مطمئن شوید که SEO- دارید، در اینجا چند دلیل مهم است که فایل robots.txt خود را در نظر بگیرید. سایت وردپرس دوستانه.

می توانید بودجه خزیدن خود را بهینه کنید

بودجه خزیدن، یا سهمیه خزیدن، تعداد صفحاتی است که ربات های موتور جستجو در هر روز در وب سایت شما می خزند. اگر فایل robots.txt بهینه سازی شده ای ندارید، ممکن است بودجه خزیدن خود را هدر دهید و از خزیدن ربات ها در صفحات سایت شما که می خواهید برای اولین بار در SERP ها ظاهر شوند جلوگیری کنید.

اگر محصولات یا خدماتی را از طریق سایت وردپرس خود می فروشید، در حالت ایده آل می خواهید صفحاتی با بهترین تبدیل فروش باید توسط ربات های خزنده اولویت بندی شود.

شما می توانید صفحات فرود مهم خود را اولویت بندی کنید

با بهینهسازی فایل robots.txt خود، میتوانید اطمینان حاصل کنید که صفحات فرودی که میخواهید ابتدا در SERP ظاهر شوند، برای رباتهای خزنده آسان و سریع هستند. تقسیم ایندکس سایت خود به «صفحات» و «پستها» به ویژه برای این کار مفید است، زیرا میتوانید اطمینان حاصل کنید که پستهای وبلاگ در SERP ظاهر میشوند نه فقط صفحات فرود استاندارد شما.

به عنوان مثال، اگر وب سایت شما صفحات زیادی دارد و دادههای مشتری نشان میدهد که پستهای وبلاگ شما خریدهای زیادی ایجاد میکنند، میتوانید از نقشههای سایت در فایل robots.txt خود استفاده کنید تا مطمئن شوید که پستهای وبلاگ شما در SERP ظاهر میشوند.

شما می توانید کیفیت کلی سئوی وب سایت خود را بهبود بخشید

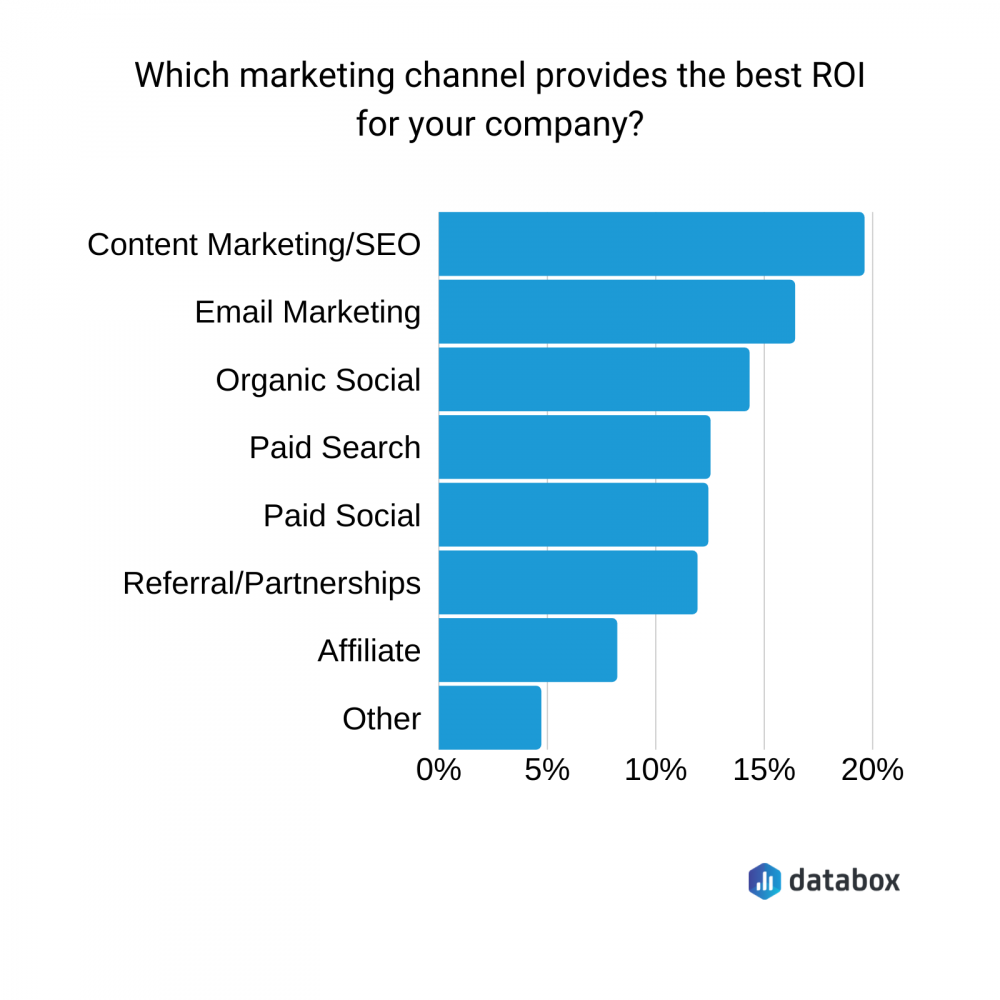

بازاریابان به خوبی از ROI بهینه سازی موتور جستجو آگاه هستند. هدایت جستجوهای ارگانیک به سمت وب سایت خود با تمرکز بر SEO آن ارزان تر و اغلب مؤثرتر از تبلیغات پولی و پیوندهای وابسته است – اگرچه هر دو هنوز کمک می کنند. این آمار را برای ROI کانال بازاریابی بررسی کنید.< /p>

بهینه سازی فایل robots.txt تنها راه برای بهبود رتبه جستجوی وب سایت یا وبلاگ شما نیست. شما همچنان باید در خود صفحات محتوای مناسب سئو داشته باشید، که ممکن است به یک SEO SaaS برای کمک. با این حال، ویرایش فایل robots.txt کاری است که می توانید به راحتی خودتان انجام دهید.

نحوه ویرایش فایل Robots.txt در وردپرس

اگر می خواهید فایل robots.txt خود را در وردپرس ویرایش کنید، راه های مختلفی برای انجام آن وجود دارد. بهترین و ساده ترین گزینه اضافه کردن یک افزونه به سیستم مدیریت محتوای – داشبورد وردپرس شما است.

یک افزونه SEO به وردپرس خود اضافه کنید

این ساده ترین راه برای ویرایش فایل robots.txt وردپرس شما است. تعداد زیادی افزونه خوب SEO وجود دارد که به شما امکان می دهد فایل robots.txt را ویرایش کنید. برخی از محبوب ترین آنها Yoast، Rank Math و All In One SEO هستند.

یک افزونه Robots.txt به وردپرس خود اضافه کنید

افزونه های وردپرس نیز وجود دارد که به طور خاص با ویرایش فایل robots.txt شما طراحی شده اند. پلاگین های محبوب robots.txt عبارتند از Virtual Robots.txt، WordPress Robots.txt Optimization و Robots.txt Editor.

چگونه فایل Robots.txt وردپرس خود را آزمایش کنیم

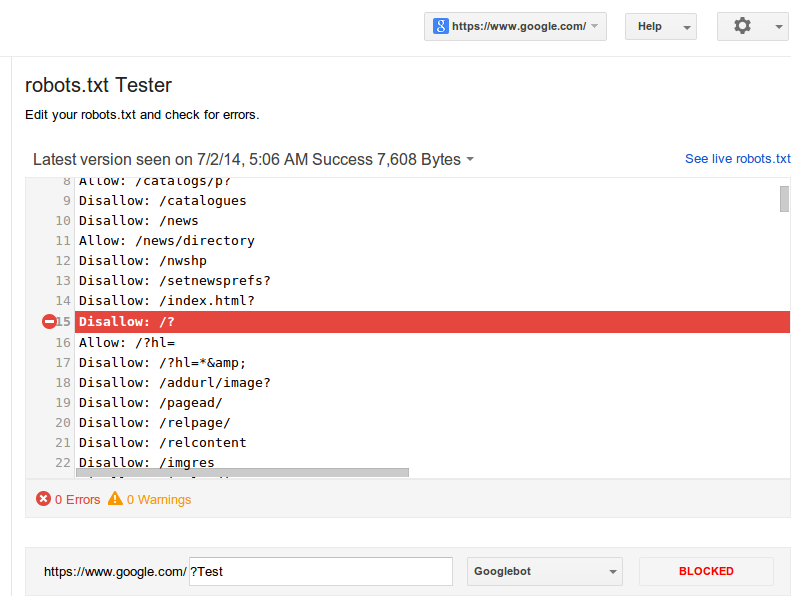

اگر فایل robots.txt خود را ویرایش کرده اید، مهم است که آن را آزمایش کنید تا مطمئن شوید که هیچ اشتباهی مرتکب نشده اید. اشتباهات در فایل robots.txt شما می تواند منجر به حذف کامل وب سایت شما از SERP شود.

Google Webmaster یک ابزار تست robots.txt دارد که می توانید به صورت رایگان برای آزمایش فایل خود از آن استفاده کنید. برای استفاده از آن، به سادگی URL صفحه اصلی خود را اضافه کنید. فایل robots.txt ظاهر میشود و “هشدار نحو” و “خطای منطقی” را در هر خطی از فایل که کار نمیکند مشاهده خواهید کرد.

سپس میتوانید صفحه خاصی را از وبسایت خود وارد کنید و یک کاربر عامل را برای اجرای آزمایشی انتخاب کنید که نشان میدهد آیا آن صفحه «قبول شده» یا «مسدود شده است». میتوانید فایل robots.txt خود را در ابزار تست ویرایش کنید و در صورت نیاز دوباره آزمایش را اجرا کنید، اما توجه داشته باشید که این کار فایل واقعی شما را تغییر نمیدهد، باید اطلاعات ویرایش شده را کپی و در ویرایشگر robots.txt خود جایگذاری کنید. آن را در آنجا ذخیره کنید.

چگونه فایل وردپرس Robots.txt خود را برای سئو بهینه کنیم

سادهترین راه برای بهینهسازی فایل robots.txt این است که انتخاب کنید کدام صفحات را میخواهید غیرمجاز کنید. در وردپرس، صفحات معمولی که ممکن است مجاز نباشید عبارتند از: /wp-admin/، /wp-content/plugins/، /readme.html، /trackback/.

به عنوان مثال، ارائهدهنده بازاریابی SaaS صفحات مختلف زیادی دارد. و در سایت وردپرس خود پست کنند. با غیر مجاز کردن صفحاتی مانند /wp-admin/ و /wp-content/plugins/، آنها می توانند اطمینان حاصل کنند که صفحاتی که برایشان ارزش گذاری می کنند توسط ربات های خزنده اولویت بندی می شوند.

نقشه سایت ایجاد کنید و آنها را به فایل Robots.txt خود اضافه کنید

WordPress زمانی که یک وبلاگ یا وب سایت با آن ایجاد می کنید، یک نقشه سایت عمومی برای خود ایجاد می کند. این را معمولاً می توان در example.wordpress.com/sitemap.xml یافت. اگر میخواهید نقشه سایت خود را سفارشی کنید و نقشههای سایت اضافی ایجاد کنید، باید از robots.txt یا افزونه SEO وردپرس استفاده کنید. .

شما می توانید به افزونه خود در داشبورد وردپرس خود دسترسی داشته باشید و باید بخشی برای فعال کردن و ویرایش نقشه سایت شما داشته باشد. افزونه های خوب به شما امکان می دهند نقشه های سایت اضافی مانند نقشه سایت “صفحات” و نقشه سایت “پست ها” را به راحتی ایجاد و سفارشی کنید.

وقتی نقشههای سایت تنظیم میشوند، به سادگی آنها را به فایل robots.txt خود اضافه کنید:

رویکرد حداقلی داشته باشید

در حالی که ممکن است ویرایش و بهینهسازی فایل robots.txt وردپرس شما هیجانانگیز باشد، مهم است که رویکردی حداقلی و کمتر است. این به این دلیل است که اگر صفحاتی را در سایت خود مجاز نکنید، ربات های خزنده نتوانند آن صفحات را برای صفحات دیگر جستجو کنند. این می تواند به این معنی باشد که صفحات کلیدی کشف نمی شوند و یکپارچگی ساختاری سایت شما از دیدگاه ربات های موتور جستجو ضعیف می شود.

همچنین نیازی به “اجازه دادن” دسترسی به هر صفحه در وب سایت خود در robots.txt وجود ندارد. رباتهای خزنده قبلاً آن صفحات را پیدا میکنند – به جای آن روی نقشههای سایت و صفحاتی که باید مجاز نکنید تمرکز کنید تا ابتدا صفحات کلیدی شما پیدا شوند.

در این راهنما، ما هر آنچه را که باید در مورد فایلهای WordPress robots.txt بدانید، ارائه کردهایم. از توضیح اینکه فایلهای robots.txt چیست تا اینکه چرا و چگونه باید فایل robots.txt خود را برای سئو بهینه کنید، این مقاله به شما کمک میکند تا راههای ساده و موثری برای بهبود رتبه جستجوی وبسایت وردپرس خود پیدا کنید.