سس مخفی هوش مصنوعی اپل ظاهرا از پردازندههای گرافیکی NVIDIA صرف نظر میکند و از تراشههای گوگل برای آموزش استفاده میکند.

این توصیه سرمایه گذاری نیست. نویسنده در هیچ یک از سهام ذکر شده هیچ سمتی ندارد. Wccftech.com یک خط مشی اخلاقی و افشای اطلاعات دارد.

به نظر میرسد اپل غول فناوری کوپرتینویی در یک مقاله تحقیقاتی جدید که قابلیتهای آموزش هوش مصنوعی خود را برای آیفون و سایر محصولات اعلام شده در سال جاری اعلام کرد، به جای انویدیا رهبر بازار، بر تراشههای گوگل تکیه کرده است. صعود NVIDIA به صدر زنجیره غذایی ارزش بازار مبتنی بر تقاضای شدید برای پردازندههای گرافیکی آن است که درآمد و درآمد را با درصدهای سه رقمی بالاتر برده است.

با این حال، اپل در مقاله خود به اشتراک میگذارد که 2.73 میلیارد پارامتر Apple Foundation Model (AFM) به خوشههای ابری واحد پردازش تانسور v4 و v5p (TPU) که معمولاً توسط Google Alphabet Inc ارائه میشوند، متکی است.

رویکرد هوش مصنوعی اپل متکی به استفاده از TPU به جای پردازنده گرافیکی مقاله تحقیقاتی را نشان می دهد

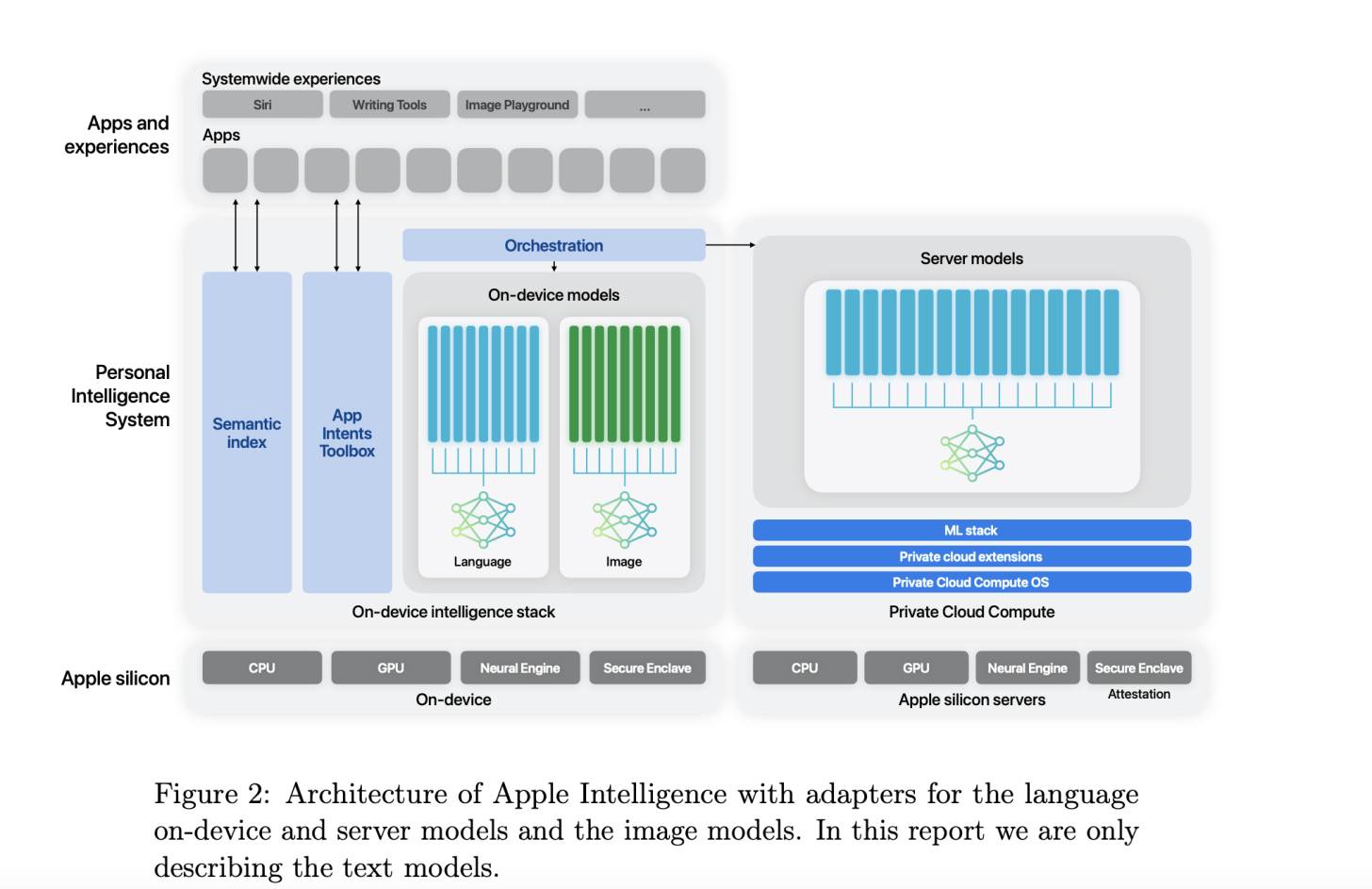

مقاله تحقیقاتی اپل که اوایل امروز منتشر شد، زیرساختهای آموزشی و سایر جزئیات مربوط به مدلهای هوش مصنوعی را پوشش میدهد که ویژگیهای اعلامشده در WWDC در اوایل سال جاری را تقویت میکنند. اپل هم در زمینه پردازش هوش مصنوعی دستگاه و هم در پردازش ابری اعلام کرد، و در قلب این ویژگی های هوش مصنوعی، مدل بنیاد اپل با نام AFM قرار دارد.

برای AFM روی سرور، یا مدلی که ویژگیهای هوش مصنوعی ابری به نام Apple Cloud Compute را تقویت میکند، اپل به اشتراک گذاشت که یک مدل هوش مصنوعی ۶.۳ تریلیون رمزی “از ابتدا” در “ آموزش میدهد. تراشه های 8192 TPUv4.” تراشههای TPUv4 Google در غلافهایی از 4096 تراشه در دسترس هستند.

اپل اضافه کرد که مدلهای AFM (هم روی دستگاه و هم در فضای ابری) بر روی تراشههای TPUv4 و کلاسترهای v5p Cloud TPU آموزش داده شدهاند. v5p بخشی از ابر رایانه هوش مصنوعی گوگل است و در دسامبر سال گذشته معرفی شد.

هر غلاف v5p از 8960 تراشه ساخته شده است و به گفته گوگل، دو برابر عملیات ممیز شناور در ثانیه (FLOPS) و سه برابر حافظه نسبت به TPU v4 برای آموزش مدلها تقریباً سه برابر سریعتر ارائه میکند.

برای مدل هوش مصنوعی روی دستگاه برای ویژگیهایی مانند نوشتن و انتخاب تصویر، اپل از مدل 6.4 میلیارد پارامتری استفاده میکند که “از ابتدا با استفاده از همان دستور العمل سرور AFM آموزش داده شده است.” اپل همچنین تصمیم گرفت برای مدل سرور AFM به تراشه های قدیمی تر V4 TPU تکیه کند. همانطور که در بالا مشخص شد، از تراشههای 8092 v4 TPU استفاده میکرد، اما برای مدل AFM روی دستگاه، شرکت تصمیم گرفت بر روی تراشههای جدیدتر تکیه کند. به گفته اپل، این مدل بر روی تراشه های 2048 TPU v5p آموزش داده شده است.

سایر جزئیات به اشتراک گذاشته شده در مقاله شامل ارزیابی مدل برای پاسخ های مضر، موضوعات حساس، صحت واقعی، عملکرد ریاضی و رضایت انسان از خروجی های مدل است. به گفته اپل، سرورهای AFM و مدلهای روی دستگاه، در زمینه سرکوب خروجیهای مضر همتایان خود در صنعت پیشرو هستند.

برای مثال، سرور AFM، در مقایسه با OpenAI’s GPT-4 دارای نرخ نقض مضر خروجی 6.3٪ است که به طور قابل توجهی کمتر از GPT-4 28.8٪ است، داده های اپل نشان می دهد. به طور مشابه، در دستگاه AFM نرخ تخلف 7.5% کمتر از امتیاز Llama-3-8B (آموزش داده شده توسط متای مادر فیسبوک) 21.8% بود.

برای خلاصهسازی ایمیل، پیام و اعلان، AFM روی دستگاه به ترتیب 71.3 درصد، 63 درصد و 74.9 درصد رضایت داشت. مقاله تحقیقاتی به اشتراک گذاشت که اینها مدل های Llama، Gemma و Phi-3 را هدایت کردند.